AR智慧型眼鏡的設計依賴雙目相機、雷射掃描成像系統、光波導及多種感測器的協同運作。與虛擬實境(VR)裝置的主要差異在於AR能在真實世界中疊加數位資訊,而VR則創造完全沉浸的虛擬環境。

擴增實境(Augmented Reality, AR)是指將虛擬的數位資訊,即時地整合至使用者的真實環境中。AR技術將內容疊加到現實世界上,豐富而不是取代使用者對真實環境的感知。AR雙目相機(Stereo Cameras)使用兩個鏡頭,從略微不同的角度捕捉影像,藉此計算深度,並創建仿真的3D環境。本文將介紹植基於AR雙目相機的AR智慧型眼鏡(Smart Glasses)設計技術。

VR/AR的挑戰

AR眼鏡與虛擬實境(Virtual Reality, VR)頭戴顯示裝置的主要差異在於它們的用途與沉浸(Immsersion)程度。AR眼鏡是在真實世界中疊加數位資訊,讓使用者在鏡片中仍能看到周遭的真實環境;而VR頭戴裝置則是創造一個完全沉浸的虛擬世界,並取代真實環境。另外,混合實境(Mixed Reality, MR)頭戴裝置的基本原理和AR眼鏡相似,都是透過光學顯示與感測器將虛擬資訊與真實世界結合。但AR著重於疊加資訊;而MR強調互動融合,能使虛擬物件與真實環境產生物理一致性的交互關係。表1是VR頭戴裝置、新興的VR眼鏡、AR眼鏡、MR頭戴裝置在各方面的比較。

表1 VR頭戴裝置、新興的VR眼鏡、AR眼鏡、MR頭戴裝置的比較

表1 VR頭戴裝置、新興的VR眼鏡、AR眼鏡、MR頭戴裝置的比較

目前在市場上主要的VR裝置仍然是頭戴式顯示器,而不是輕型眼鏡。由於沉浸的應用需求量仍不夠大,難以將顯示器壓縮到如眼鏡般的大小。但仍有一些新創公司與研究機構正嘗試設計輕型的VR或MR眼鏡,但仍屬於原型機或小眾產品,尚未成為主流。雖然那些產品的外觀更接近眼鏡,但本質上仍是VR/MR頭戴式顯示器的縮小版,需要遮光罩或額外模組才能實現完整的沉浸感。

VR和AR在過去幾年曾備受媒體關注。它們有望在遊戲、醫療保健、人員培訓、工程、建築、室內設計、旅遊、國防等眾多領域帶來商機。但時至今日,VR和AR尚未對大多數人的生活產生顯著的影響。主要原因有兩個:VR/AR顯示裝置的品質和成本。具體來說,VR/AR顯示裝置的品質包括:影像亮度、解析度、視野(Field Of View, FOV)、資料處理速率和功耗等。此外,頭戴裝置的體積、重量和電池續航時間等實用性因素也很重要。

核心架構

以AR雙目相機設計的智慧型眼鏡主要元件中,除了雙目相機模組以外,還有雷射掃描成像(Laser Beam Scanning, LBS)系統、光波導(Optical Waveguide)或微發光二極體(MicroLED)、應用處理器、各種感測器(Sensor),如圖1所示。

圖1 以AR雙目相機設計的智慧型眼鏡的外觀和主要元件

圖1 以AR雙目相機設計的智慧型眼鏡的外觀和主要元件

這些元件共同構成了AR眼鏡的核心架構,各自負責感知、顯示、運算與互動,最後實現完整的虛實融合體驗。以下是各元件的功能說明:

雙目相機模組

模擬人眼視差,計算場景深度。它負責建立3D空間模型或自駕車的同時定位與繪圖(SLAM),支援手勢追蹤、物件辨識、空間定位與虛擬物件錨定(Virtual Object Anchoring)。透過神經網路可即時估算視差圖(Disparity Map),並生成視覺特效。虛擬物件錨定是指將虛擬的物件穩定地放置在真實世界中的某個位置,並隨著使用者移動保持一致的空間關係。

LBS成像系統

它包含RGB雷射光源和屬於微機電系統(MEMS)的微型光學掃描器。其工作原理是使用屬於MEMS的微型反射鏡偏轉雷射束,在眼鏡的鏡片上逐點掃描形成影像,如圖2。它負責顯示虛擬內容(例如:數位訊息、指示方向的箭頭符號),提供高亮度、高色域的微型投影。其優點是:體積小、功耗低、可隱藏於鏡框,極適合AR眼鏡使用。

圖2 LBS微型投影系統的原理

圖2 LBS微型投影系統的原理

光波導

LBS成像後的光線被導入光波導,聚焦並導入眼鏡鏡片中,最後投射到使用者的眼睛,形成虛擬螢幕。它負責將虛擬影像於真實視野中顯示。其技術類型或光學元件包含:薄膜波導、光柵耦合器、體積全息光學元件(Volume Holographic Optical Element, VHOE)。設計時,需兼顧清晰度、視野範圍與製造成本。

感測器整合

主要整合慣性測量單元(IMU)、飛時測距(Time of Flight, ToF)、結構光(Structured Light)、麥克風、環境光線等感測器。在AR眼鏡中,ToF和結構光模組可嵌入鏡框或眼鏡的鼻樑處,用於近距離的手勢追蹤、臉部辨識等。在AR、VR、MR系統中,常使用ToF、結構光與雙目相機融合,如此能明顯提升深度估算的精確度與穩定性,這就是所謂的多感測器融合(Multi-Sensor Fusion)。這些感測器具有:六自由度(6DoF)的姿態追蹤、手勢辨識、語音控制、環境感知與互動等功能。融合的方法除了上述的多感測器融合以外,還包含時間同步與濾波演算法(如卡爾曼濾波器Kalman filter)。

應用處理器

負責執行AI推論、影像處理、感測器融合、影像顯示和控制。設計時,需考量在有限空間內,達成高效能、低延遲與低功耗的目標。

AR眼鏡是由雙目相機感知空間、LBS顯示虛擬內容、光波導將光線傳送至眼睛、整合感測器提供互動、應用處理器負責運算所組成的協同系統。每個模組都扮演關鍵角色,缺一不可。

虛擬物件的錨定

若要讓虛擬物件看起來像真的存在於空間中,就必須:使用雙目相機計算場景深度,並產生點雲。處理器和應用軟體根據雙目相機和各種感測器收集到的環境資訊和用戶指令,生成對應的虛擬內容(例如:3D模型、人機介面),計算和輸出渲染(Rendering)後的影像。虛擬影像是根據空間資訊正確地錨定在真實場景中。透過LBS顯示模組和光波導將影像投射到眼睛。使用者的雙眼同時接收真實與虛擬光線,形成融合的3D感知效果(如懸浮的立方體)。

圖3表示AR眼鏡的多感測器融合與影像顯示的流程。圖4表示AR眼鏡整合了真實光線和虛擬影像的顯示,以及雙眼的3D感知,最後雙眼看到虛擬物件(如立方體)懸浮在空間中。

圖3 AR眼鏡的多感測器融合與影像顯示流程

圖3 AR眼鏡的多感測器融合與影像顯示流程

圖4 AR眼鏡整合真實光線和虛擬影像的顯示,以及雙眼的3D感知

圖4 AR眼鏡整合真實光線和虛擬影像的顯示,以及雙眼的3D感知

為了使虛擬影像能錨定在真實的空間中,必須根據使用者頭部姿態與環境座標進行空間定位。座標轉換可確保虛擬物件能在真實場景中正確錨定、遮擋與透視。AR眼鏡的座標轉換主要是使用模型-視圖-投影轉換矩陣,如公式(1),它是先使用M矩陣將虛擬物件轉換至世界座標,然後使用V矩陣轉換至相機座標,最後使用P矩陣轉換到裁剪空間(Clip Space)。

由於MVP是4×4矩陣,所以與MVP相乘的模型頂點是以齊次座標(Homogeneous Coordinate)來表示,亦即在原本的笛卡兒座標上增加了一個額外的維度。這種表示方法可以將平移、旋轉、縮放的映射,轉換成單一的矩陣乘法來表示。裁剪空間也是以齊次座標表示,必須使用公式(2)才能將它轉換成正規化裝置座標(Normalized Device Coordinate, NDC),或稱作規範視察體(Canonical View Volume, CVV)座標。公式(2)中的w是齊次座標的第四元素,這步驟也稱為透視除法。

由於NDC的座標範圍在[-1,1],它還不是螢幕上的2D像素座標。若要得到真正的螢幕座標,還必須使用視域轉換矩陣(Viewport Transform Matrix)才行。如圖5。這裡需注意數學公式裡的視域參數和圖形應用程式介面(API)定義的螢幕座標之區分。若使用OpenGL,其螢幕或視窗原點在左下角,常見的原點設定是(x_vp,y_vp)=(0,0),y軸是往上遞增。若是使用Direct3D(D3D)或Vulkan軟體,其螢幕原點在左上角,常見的原點設定仍是(x_vp,y_vp)=(0,0),但這裡的y=0是螢幕的最上方,y軸是往下遞增。因此,若是使用Direct3D(D3D)或Vulkan,圖5中的視域轉換矩陣中的y軸需做上下翻轉,如圖6。

圖5 使用OpenGL的視域轉換矩陣求出螢幕/像素座

圖5 使用OpenGL的視域轉換矩陣求出螢幕/像素座

圖6 使用D3D/Vulkan的視域轉換矩陣求出螢幕/像素座標

圖6 使用D3D/Vulkan的視域轉換矩陣求出螢幕/像素座標

指令的輸入

使用者可以利用下列三種方法,透過AR眼鏡的虛擬螢幕輸入指令:

手勢/姿勢操作

利用鏡框上的攝影機或外部感測器,辨識手勢、頭部動作、肢體動作或姿勢,取代滑鼠、鍵盤或觸控螢幕。例如:使用者配戴的手環或指環,結合IMU與藍牙通訊傳輸,提供更精準的手勢輸入。表2列出不同的感測器與支援的操作方式。

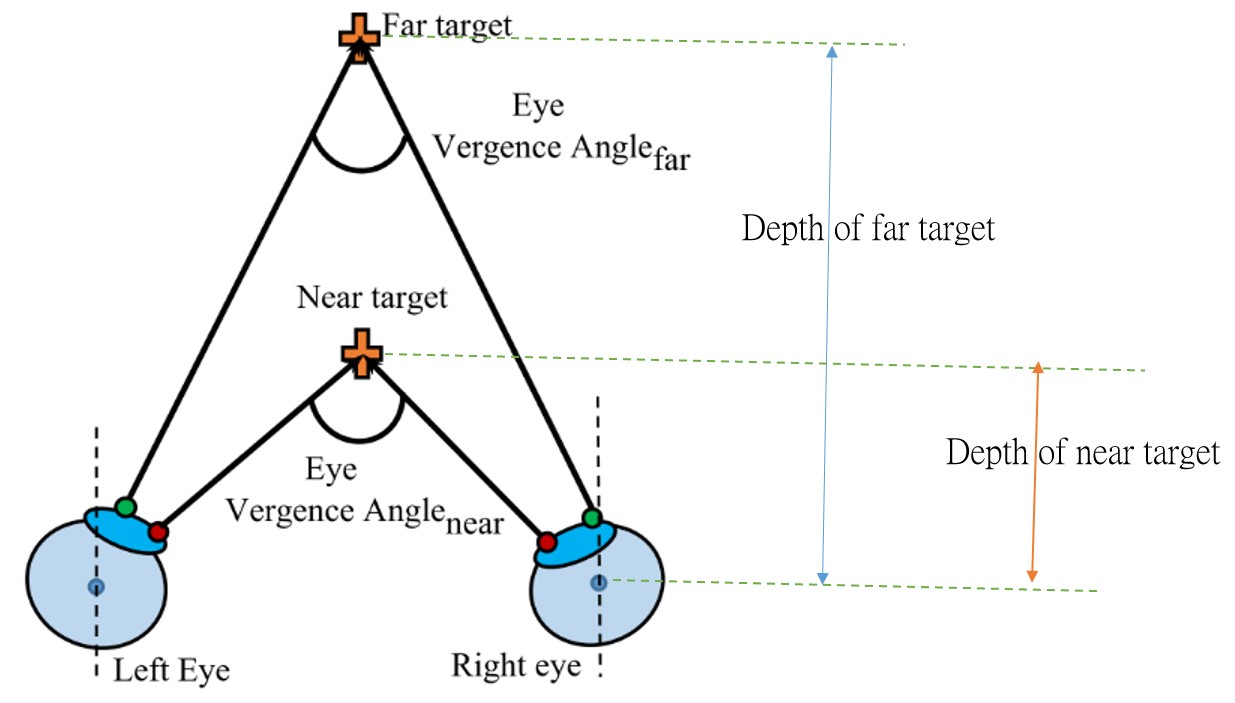

表2 AR眼鏡所採用的不同感測器與支援的操作方式

表2 AR眼鏡所採用的不同感測器與支援的操作方式

眼球追蹤(Eye Tracking)

偵測使用者的視線方向,讓介面能根據使用者的注視點(Gaze Point)自動選擇或放大資訊。注視點也能結合手勢或語音來觸發指令,如此可減少手控操作,提升精準度。

語音控制

結合AI語音助理,使用者可以直接用語音下達指令。例如:對著虛擬螢幕直接說開啟文件、放大即可觸發指令。

眼球追蹤

眼球追蹤是利用光學與影像處理技術,測量眼睛的運動與注視方向,最常見的方法是瞳孔中心角膜反射(Pupil Center Corneal Reflection, PCCR)。PCCR是一種非接觸式、高精度的眼球運動追蹤技術,透過近紅外光照射眼睛,捕捉角膜上的反射光點或光斑(因角膜反射形成的閃爍點(Glint))和瞳孔的中心位置,利用它們之間的相對變化來計算視線方向。只要光源與頭部的相對位置保持不變,角膜上的反射光點位置幾乎不會移動,瞳孔位置則會隨著眼球轉動而改變。當眼球轉動時,瞳孔中心相對於角膜反射光點的位置會改變,因為角膜反射光點的位置不變,可當成基準點,此相對的位移就是眼球的運動,PCCR系統透過這個相對位移,推算出眼球的旋轉角度。然後,演算法結合使用者的眼睛幾何模型,將瞳孔中心–角膜反射向量轉換成視線方向,最後得到使用者的注視點。

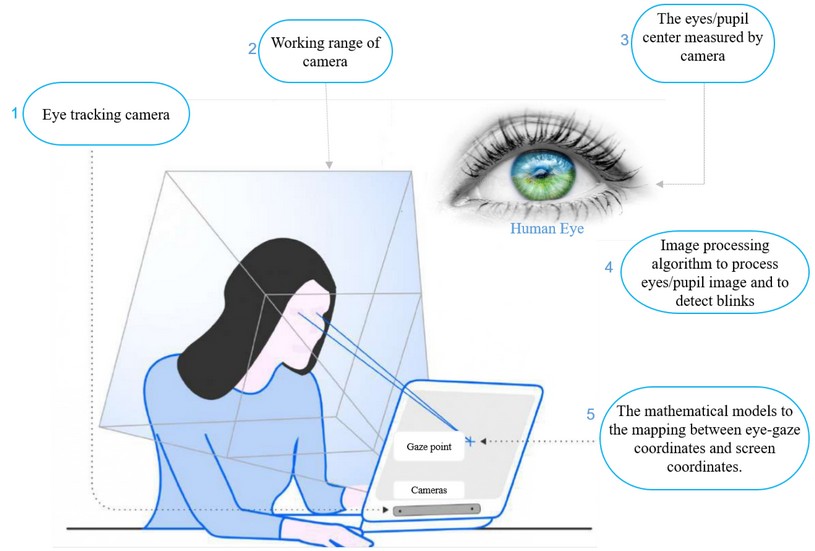

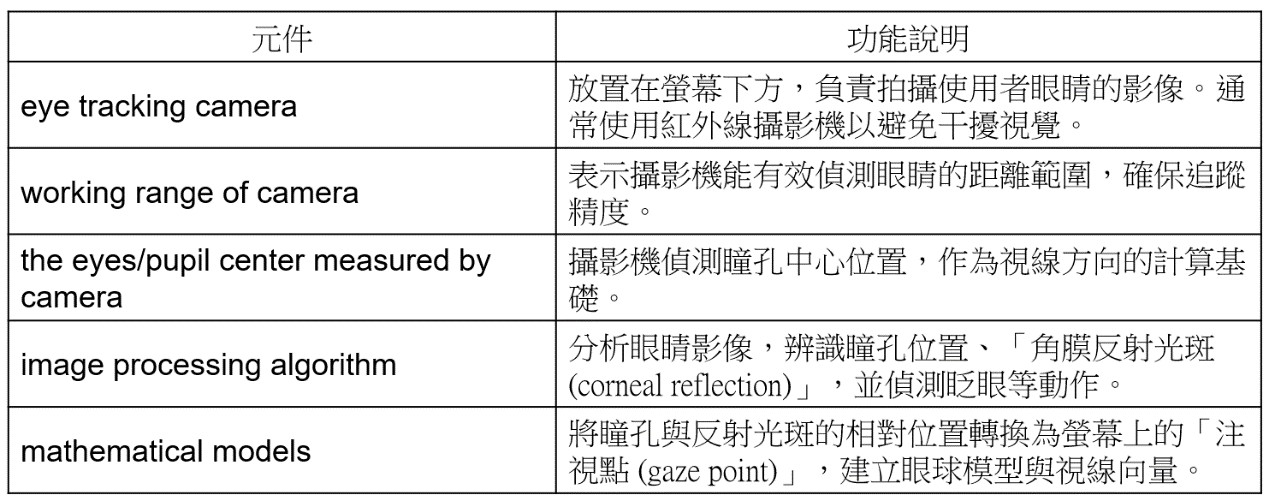

圖7是一個典型的PCCR眼球追蹤系統的工作流程及其各元件的功能說明。圖8是雙眼的輻輳角(Eye Yergence Angle)和深度的幾何關係。

圖7 一個典型的PCCR眼球追蹤系統的工作流程

圖7 一個典型的PCCR眼球追蹤系統的工作流程

圖8 雙眼的眼球追蹤系統的輻輳角(Eye Vergence Angle)和深度的幾何關係

圖8 雙眼的眼球追蹤系統的輻輳角(Eye Vergence Angle)和深度的幾何關係

AR眼鏡的眼球追蹤模組的校正目標是:必須將原始的眼球影像、注視向量和螢幕上的注視點對齊。唯有這三者對齊,才能保證使用者的眼睛看哪裡,AR眼鏡就能精確地在虛擬螢幕上將那位置標示出來。